Dans les tests des campagnes digitales et des autres opérations, le calcul statistique est un outil incontournable pour statuer sur la fiabilité des résultats constatés. Affirmer dans un test A/B que le taux de transformation de A est supérieur à celui de B, passe par une évaluation statistique.

Dans les tests des campagnes digitales et des autres opérations, le calcul statistique est un outil incontournable pour statuer sur la fiabilité des résultats constatés. Affirmer dans un test A/B que le taux de transformation de A est supérieur à celui de B, passe par une évaluation statistique.Presque toutes les disciplines scientifiques ont recours à ces outils pour conforter leurs affirmations. L'utilisation de ces processus sont attachés à de nombreuse méthodes, parmi celles les plus connues on trouve les tests d'hypothèse avec la notion d'intervalles de confiance. Les tests permettent de confronter deux hypothèses: l’hypothèse « Nulle » et « Alternative », en rejetant une au profit de l’autre. Cette pratique a pour objectif de déterminer parmi les deux hypothèses, laquelle est la plus vraisemblable. Les intervalles de confiance ont pour but de fixer des marges qui accordent une certaine confiance aux résultats. Par exemple pour déterminer la proportion d'intention de vote d'une population donnée, on dira que cette dernière se trouve dans un intervalle de [43%; 49%] à 95% de confiance ( la taille de l'intervalle dépend du nombre de personnes interrogée, ici environ 400).Ces deux outils s'inscrivent dans le cadre d'une approche dite fréquentiste de l'inférence statistique. Cette dernière manipule des quantités appelées estimateurs pour faire de l'inférence statistique. Ces estimateurs deviennent des composantes sur lesquelles les tests d'hypothèse et intervalles de confiances sont obtenus. Pour pouvoir appliquer ces tests ou construire des intervalles de confiance, il essentiel d'avoir un échantillon aléatoire ( sondage) à partir duquel on infère les résultats généraux. Cette inférence est une procédure qui permet à partir des données de remonter aux causes de leur réalisation, en vue de généraliser ses conclusions à l'ensemble de la population; elle prend des formes paramétriques et non-paramétriques.

- L'inférence paramétrique suppose que le processus de réalisation des données observées est identifiable parmi un ensemble de lois de probabilité indexées par un paramètre θ. L'inférence est effectuée pour cibler le paramètre, et ainsi déterminer la loi de probabilité qui régit le phénomène. Le test en t de comparaison de deux moyennes en est un exemple.

- L'inférence non paramétrique, comme son nom l'indique ne suppose pas l'existence d'un paramètre d'intérêt, elle raisonne directement sur les lois de probabilité. Le test du Chi 2 en est l'exemple type.

Une des premières différences dans l’approche bayésienne par rapport au raisonnement fréquentiste réside dans la façon de définir une probabilité. Le raisonnement bayésien définit la probabilité d’un évènement comme un pari sur sa future réalisation. Cette optique est dite subjective car elle est liée à l’individu. De son coté le cadre classique définit la probabilité comme la limite de sa fréquence de réalisation en supposant que les évènements sont répétables et réalisables dans des conditions identiques. La première limite de ce raisonnement est le cas des évènements non répétables (à notre horizon), par exemple qu'un astéroïde percute la terre. Dans ce cas la probabilité ne peut être qu’un pari et non le fruit d'une régularité.

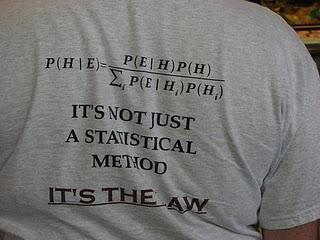

La deuxième divergence réside dans la façon d’analyser. Contrairement au cadre fréquentiste le calcul bayésien attribue une loi de probabilité sur le paramètre. Implicitement cela signifie que le paramètre d’intérêt θ est vu comme une variable aléatoire. L’intérêt d’une telle loi est de traduire la connaissance disponible avant observations. Cette loi dite loi a priori sur le paramètre, peut résumer un avis d'expert ou encore des anciennes données. Durant l'analyse, Elle se transformera en une loi a posteriori dès que les données seront observées. Cette actualisation est rendue possible grâce à la formule de Bayes.

Ainsi sachant qu'une clientèle est constituée de 3 segments, et que les taux de réponse dans les trois segments sont de 1%, 2% et 3%, on peut calculer aisément la probabilité qu'un client ayant répondu appartienne au premier segment est de : 1/3*0.01 /(1/3*0.01+1/3*0.02 +1/3*0.03 ) = 0.17 ( de 0.33 et 0.5 pour les deux autres segments). En revanche si on connait la distribution des clients entre les segment ( 50%, 40% et 10%), le calcul est modifié et la probabilité est de 0.31%. La connaissance a priori de la répartition nous permet d'actualiser le calcul. ( la formule est sur le t-shirt).

D’après Robert (2006), L'analyse statistique bayésienne se ramène fondamentalement à une inversion. De cette façon elle permet de remonter des effets (données disponibles) aux causes (paramètres). Le grand avantage de cette optique est que les résultats obtenus sont avancés sachant les données et non de façon asymptotique. Ce constat devient très utile pour résoudre les problèmes de décision où peu de données sont disponibles.

L'approche bayésienne est étroitement liée à la théorie de la décision. Elle utilise des éléments de cette théorie, pour contrôler les résultats de l'inférence. Cette harmonie est rendue possible grâce aux manipulations des lois a posteriori sur les paramètres. Ce cadre décisionnel permet d'effectuer des tests d'hypothèses et construire des intervalles de crédibilité. Néanmoins le cadre bayésien trouve des critiques dans la façon de fixer ses lois a priori. Car l’information introduite via ces lois, est dite subjective et peu perturber les résultats finaux. Une réponse à cette question est partiellement résolue par les a priori non informatifs (loi uniforme, prior de jeffrey, etc...), mais un grand travail reste à faire dans se sens.

Pour un bayésien toute information disponible est importante, de plus injecter des informations ainsi est en accord avec sa vision de pari probabiliste. Pour lui être objectif, est de bien justifier ses choix dans l’analyse. Même si ce choix de modélisation reste incompris, les lois a priori sont bien utiles aux bayésiens quand on est face à un manque de données, difficulté que le cadre fréquentiste peine à combler, même si les deux approches donnent les mêmes résultats quand il y a abondance

Le cadre bayésien est une approche qui s'est beaucoup développée grâce aux outils informatiques (il peut être gourmand en calcul), et permet grâce à la mise à jour des connaissances de réactualiser les inférences statistiques. Il contribue à une approche apprenante des systèmes et des modèles telle que chaque nouvelle information permet de mettre à jour l'estimation. Le raisonnement bayésien désormais s'étend à travers de nombreuses applications : méthodes de filtrage de spam, réseaux bayésiens , méthodes d'estimation de régression linéaire et logistique via les modèles hiérarchique bayésien, méthodes de classification. Ces techniques qui permettent de modéliser des phénomènes complexes sont très prisées dans plusieurs domaines touchés par le problème d’incertitudes et les événements rares. Le raisonnement bayésien permet dans ce cas, de quantifier les incertitudes en avançant des les lois de probabilité sur lesquelles le risque peut être supervisé. Le contrôle du risque d’avalanche en est un exemple. Le champs est étendu! Il peut trouver de beaux terrains en méta-analyse.

Mais pour clore ce qui n'est qu'une invitation, voici un exemple où l'inférence bayésienne donne des capacités d'apprentissage aux robots.

Et quelques livres: